最小二乘法

假设采用二范数定义的平方误差来定义损失函数:

展开得到:

现在要最小化这个值的 :

这个式子中 又被称为伪逆。对于行满秩或者列满秩的 ,可以直接求解,但是对于非满秩的样本集合,需要使用奇异值分解(SVD)的方法,对 求奇异值分解,得到

于是:

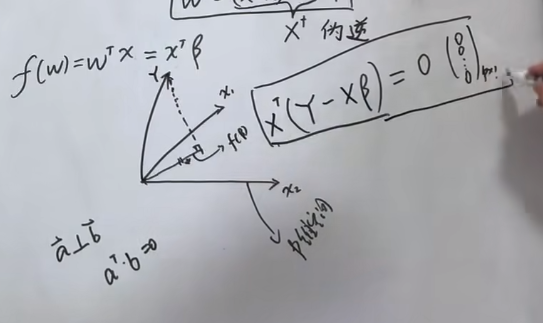

在几何上,最小二乘法相当于模型(这里就是直线)和试验值的距离的平方求和,假设我们的试验样本张成一个 维空间(满秩的情况):,而模型可以写成 ,也就是 的某种组合,而最小二乘法就是说希望 和这个模型距离越小越好,于是它们的差应该与这个张成的空间垂直:

向量空间视角

总误差分散在N个样本点上,最小二乘法使得我们拟合出的曲线总误差最小。

第二种解释:将原来的函数改写成:

这就是一个维空间,使得每个样本点尽可能地在这个空间中

每个样本点拟合的值不一定在维空间中,这时候做一个法向量,所有的法向量都和矩阵垂直。

那么现在得出结论:

即:

概率视角

噪声成高斯分布(MLE)

最幸运的情况:所有数据都在一个直线上。

但是现实生活中的数据有噪声,这里假设噪声的概率服从一个高斯分布。

对于一维的情况,记 ,那么 。代入极大似然估计(MLE)中:

这个表达式和最小二乘估计得到的结果一样。

权重先验也为高斯分布(MAP)

取先验分布 。于是:

这里省略了 ,和 没有关系,同时也利用了上面高斯分布的 MLE的结果。

我们将会看到,超参数 的存在和下面会介绍的 Ridge 正则项可以对应,同样的如果将先验分布取为 Laplace 分布,那么就会得到和 L1 正则类似的结果。